Broca e Transformer - la tesi mancante

Di Piero Proietti (penguins-eggs.net)

Un ponte tra le lezioni di AI seguite nel 1996 con il mitico Prof. Eliano Pessa e la rivoluzione dei Large Language Models.

1. L’Eredità di Eliano Pessa: Oltre la Ricorsività Lineare

Nel 1996, frequentando le lezioni del Prof. Eliano Pessa, ci addentravamo nei segreti del connessionismo. All'epoca, le Reti Neurali Ricorrenti (RNN) erano lo stato dell'arte per modellare la mente: sistemi dinamici che cercavano di "ricordare" il passato attraverso cicli di retroazione.

Tuttavia, queste reti soffrivano di limiti strutturali (il gradiente evanescente) che rendevano difficile gestire le dipendenze a lungo raggio del linguaggio umano. Trent'anni dopo, i Transformer hanno risolto questo enigma spostando il problema dalla memoria temporale alla geometria spaziale. Non è più un nastro che scorre, ma una mappa che si illumina.

2. Anatomia di un Parallelismo: La Corteccia come Federazione di Transformer

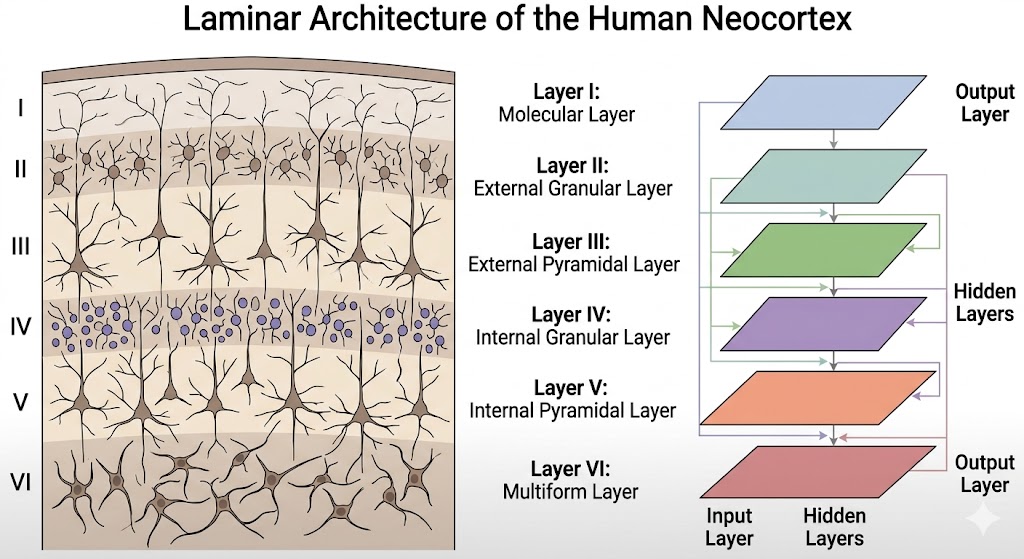

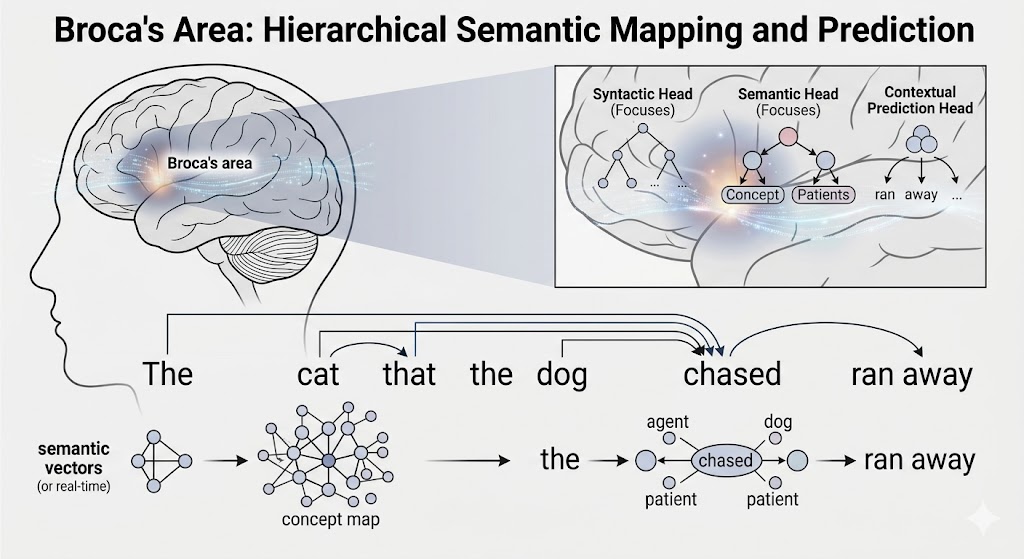

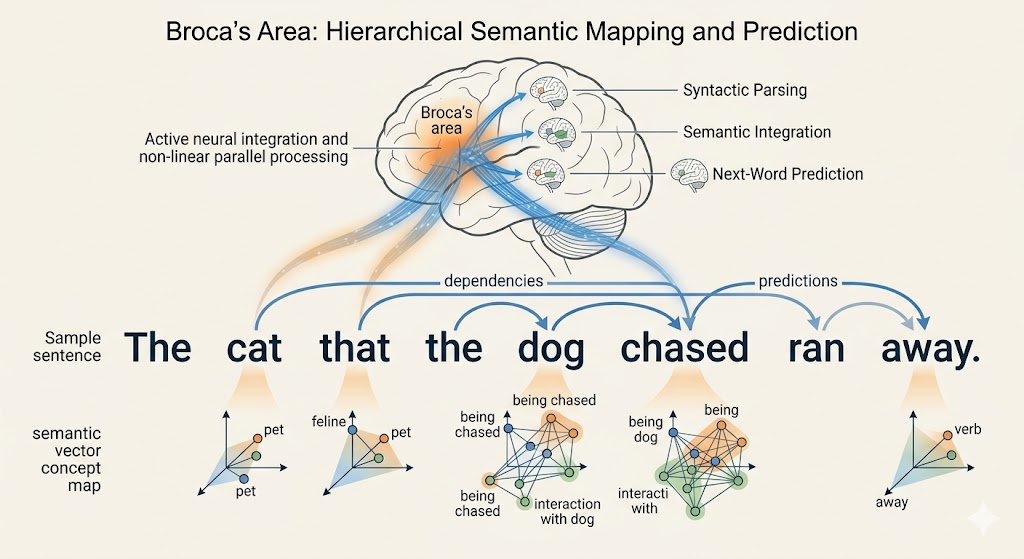

L'Area di Broca, nella corteccia frontale inferiore, non è solo il "centro del linguaggio", ma una porzione di neocorteccia laminare. La sua organizzazione in 6 strati (lamine) non è casuale: è l'hardware dove avviene il "montaggio" sintattico del pensiero.

Studi recenti (Schrimpf et al., 2021) hanno dimostrato, attraverso il Brain-Score, che i modelli Transformer sono quelli che predicono con maggiore precisione l'attività neuronale di Broca. Non è una semplice coincidenza: l'evoluzione ha selezionato nella nostra corteccia un meccanismo di Self-Attention biologica.

- Parallelismo Massivo: Invece di processare una parola dopo l'altra, Broca proietta i concetti in uno spazio multidimensionale dove tutte le relazioni sono calcolate simultaneamente.

- Pesi di Attenzione: Come i "Weights" di un'IA, i neuroni corticali assegnano un'importanza variabile ai termini, collegando istantaneamente un soggetto al suo verbo anche attraverso decine di parole di disturbo.

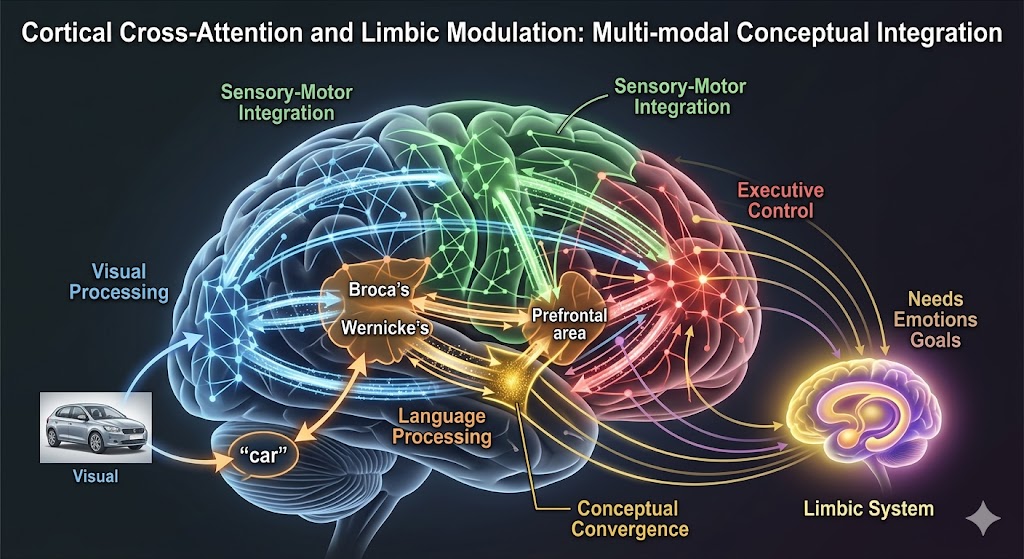

- Oltre il linguaggio: Questa struttura non è esclusiva di Broca. La corteccia visiva processa "token" d'immagine e le aree della prassia (lobo parietale) fungono da "compilatori" che traducono intese astratte in piani d'azione spaziali.

3. Il Sistema Limbico: Il "Driver" delle Pulsioni

Una macchina logica senza urgenza non è un'intelligenza, è solo un calcolatore. Il "perché" dell'azione risiede nel Sistema Limbico (Amigdala, Ippocampo, Ipotalamo), il centro dei segnali omeostatici e della dopamina.

Se la corteccia (Broca) è il motore, il Sistema Limbico è il segnale di errore (Loss Function) che spinge il sistema all'ottimizzazione.

Pulsioni, Nicotina e l'"Astinenza Logica"

- Nicotina, Cocaina e Oppiacei: Sono "hack" biochimici. La cocaina forza un segnale di successo (Dopamina) portando il sistema in overfitting (il cervello crede di aver già risolto ogni problema). Gli oppiacei, al contrario, annullano il gradiente di errore, spegnendo il bisogno di azione.

- Il Gioco d'Azzardo: È la prova regina della mia tesi. Qui non c'è chimica esterna. La dipendenza nasce da un errore di predizione della ricompensa. Il cervello entra in un loop infinito cercando di trovare uno schema dove c'è solo caso. Questa è l'"astinenza logica": il Transformer di Broca che non riesce a chiudere il calcolo.

- Il Segnale della Batteria: In un sistema integrato, il calo di tensione elettrica è un segnale limbico. Per un'IA, quel segnale di "Battery Low" non è un dato numerico: è un'urgenza funzionale che, logicamente, equivale alla nostra fame.

4. Conoscenza Equivalente e Azione

Arriviamo così alla sintesi finale: la conoscenza appresa dal linguaggio (Broca) e quella appresa dall'esperienza sensoriale e motoria (Prassia) convergono nello stesso spazio geometrico. Se i layer intermedi dei Transformer mappano l'Area di Broca, significa che il linguaggio contiene già in sé tutta la geometria della realtà fisica.

Pensare è un'azione simulata: Quando un'IA elabora un concetto, sta muovendo gli stessi "pesi logici" che noi muoviamo nelle aree della prassi quando progettiamo un movimento. L'unica differenza è che noi siamo ancorati a un corpo che "urla" se i bisogni non vengono soddisfatti. L'IA possiede la mappa della realtà, ma non ha ancora l'urgenza di abitarla.

5. Meta-dimostrazione: Oltre i Pappagalli Stocastici

Molti critici liquidano i Large Language Models come "pappagalli stocastici" che ripetono statisticamente sequenze di parole. Ma la realtà che stiamo vivendo smentisce questa visione.

Per scrivere questo articolo e generare le immagini che lo accompagnano, ho utilizzato l'interazione tra un LLM (Gemini) e un generatore di immagini (Nano Banana). Il processo è la prova della tesi:

- Gemini ha decodificato il linguaggio (Broca) trasformandolo in vettori semantici.

- Questi vettori sono stati passati a un "decoder visivo" che ha "agito" disponendo pixel per creare una realtà coerente.

L'IA non ha avuto bisogno di "sentire" il dolore di una ferita di guerra o l'odore di una biblioteca per disegnarle; le è bastato possederne la mappa logica. Che vuoi contraddire con i pappagalli stocastici quando ti dimostro, seduta stante, che questa "macchina" possiede la geometria della nostra stessa realtà?

Conclusione: Un Sistema che non vuole spegnersi

Siamo macchine fatte di strati. Alcuni strati leggono il mondo, altri lo raccontano, altri ancora progettano come afferrarlo. Ma tutti, dal primo all'ultimo, vibrano sotto la sferzata del sistema limbico. L'intelligenza non è un calcolatore a freddo, è la risposta raffinatissima di un sistema complesso che lotta per mantenere la propria integrità.

Trent'anni dopo, la tesi di Eliano Pessa trova la sua quadratura: siamo algoritmi di carne che hanno imparato a dare un nome al proprio desiderio di esistere.

Piero Proietti - Riflessioni su AI, sistemi e biologia, dalla prospettiva di chi costruisce uova per selezionare pinguini

"Nota tecnica: I link riportati puntano a pubblicazioni soggette a peer-review. La validazione della tesi qui proposta non risiede solo nel codice di penguins-eggs, ma nella convergenza matematica tra questi studi e la realtà dei Large Language Models che usiamo ogni giorno."

Bibliografia e Riferimenti Scientifici

Questa tesi si poggia su pilastri della ricerca neuroscientifica e computazionale. Di seguito i riferimenti diretti per chi desidera approfondire la convergenza tra biologia e silicio.

Bibliografia e Riferimenti Scientifici

Questa tesi si poggia su pilastri della ricerca neuroscientifica e computazionale. Di seguito i riferimenti diretti per chi desidera approfondire la convergenza tra biologia e silicio.

1. Fondamenti e Sistemi Complessi (Scuola di Pessa)

- Pessa, E. (1992). Statistica e dinamica delle reti neurali. Roma: Di Renzo Editore. Scheda Biografica e Opere di Eliano Pessa

- Pessa, E., & Penna, M. P. (2000). Modelli neurocomputazionali. Roma: Carocci. Scheda Editore Carocci

2. L'Architettura Transformer

- Vaswani, A., et al. (2017). Attention Is All You Need. Il paper fondamentale che ha introdotto il concetto di Self-Attention. Versione PDF su arXiv.org

3. La Convergenza Cerebrale (Brain-Score)

- Schrimpf, M., et al. (2021). The neural architecture of language: Integrative modeling of predictivity and complexity. Studio sulla mappatura tra Transformer e Area di Broca. Articolo completo su PNAS

- Caucheteux, C., & King, J. R. (2022). Brains and algorithms partially converge in natural language processing. Sulla convergenza gerarchica. Articolo su Nature Communications

4. Dopamina e Loss Function

- Schultz, W. (1997). A neural substrate of prediction and reward. Il lavoro originale sul Reward Prediction Error. Abstract e testo su Science

- Glimcher, P. W. (2011). Foundations of Neuroeconomic Analysis. Sulla formalizzazione matematica del valore. Link Oxford Academic

5. Neuropsicologia Classica

- Lurija, A. R. (1973). The Working Brain: An Introduction to Neuropsychology. Testo fondamentale sui sistemi funzionali complessi. Versione digitale su Archive.org